2026年2月12日、名古屋大学TOICコワーキング1Fにて、公開ワークショップ「生成AIは実際に何を生成するのか?」が開催された。

🔵基調講演

Mario Verdicchio先生:What Does Generative AI Actually Generate?

──概要

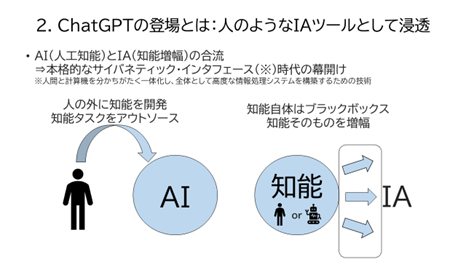

人工知能(AI)研究が初めて学術研究の一分野として確立された1955年のダートマス会議以来、「知能」や「学習」は計算可能であり、機械によって模倣可能なものとして楽観的に定義されてきた。しかし、ハワード・アール・ガードナー(Howard Earl Gardner, 1943)の多重知能理論が示すように、真の知能は計算や言語のみならず、感情や対人能力を含む複雑なものである。現在の人工知能の機能は、このような知能のごく一部を模倣しているに過ぎない。

ChatGPTのような生成AIがあたかも「自律性」や「創造性」を持っているように見えるのは、人間側がモデルの膨大なパラメータを制御・追跡しきれないことから生じる錯覚である。AIの本質は統計的な相関関係に基づくブラックボックスであり、そこに人間のような「理解」や「認識」は存在しない。

ただし、AIと人間の本質的な違いは、その認知の仕組みの違いではなく、またメカニズムの不透明性でもなく、問題が生じた際の「責任の帰属」という倫理的・社会的な側面にある。生成AIが教育や司法などの公共領域に浸透しつつある中で、私たちは生成AIの本質に関する技術的な解明を待つのではなく、生成AIという解釈不可能なシステムを社会としてどう定義し、規制すべきかという文化的・政治的な問いに向き合う必要がある。

質疑応答では主に、生成AIに対する信頼が可能かという観点について、責任の帰属可能性や処罰可能性という観点から議論がなされた。また、AIの創造性や親密性における鑑賞者・ユーザーの役割や、生成AIとの関係に関する世代間の違いなどについて論じられた。

🟢話題提供

宮澤和貴先生:ロボットの動きを生成する「フィジカルAI」

──概要

従来のロボットが特定のタスクに特化していたのに対し、ロボットの運動処理に自然言語処理を用いた事前学習と自動学習の技術を導入した「フィジカルAI」は、視覚・言語・行動を統合的に処理し、「ボールが来たから減速する」といった行動の意図を生成することが可能になる。特に、ヒューマノイドロボットは人間の動作を模倣しやすく、汎用的な学習のプラットフォームとして期待されている。また、ゲーム(Among Us)を通じた議論の学習や、ロボットが人間をリードするダンスの事例が示すように、AIは単なる受動的なツールから、環境や人間と直接インタラクションを行い、自律的に学習する存在へと進化している。

フィジカルAIが真に生成すべきものは、単なる「動き」や「言葉」にとどまらない。フィジカルAIの研究が目指すのは、大規模データに過度に依存せず、赤ちゃんが学習するように、人間と同程度のデータ量で成長過程に沿った学習や、人間とロボットが互いに学び合い共に成長するハードウェアである。

高橋英之先生:伊勢参り犬ロボット 巡礼ロボットと生成AIによる集合的物語の生成

──概要

本研究は、人間とロボットの関係における操作・被操作という二項対立を超えた、人間とロボットとの相互のコミュニケーションのデザインにある。その例として、ユーザーと共に相談しながら部屋の空調・照明の変更を提案するロボットの実験を紹介した。実体を持つロボットとの相互作用は、一般的なタブレット端末を用いた場合に比べて、部屋の環境調整をユーザーに促すことが示された。さらに、このようなロボットとの相互作用によって人の積極的な行動が促進されるような関係を、継続的に維持する方法が検討された。その鍵として注目されたのが、江戸時代の「伊勢参り犬」をモデルとした、見知らぬ他者同士が支援を通じてコミットできる「集合的物語」の創出である。

具体的には2025年8月に、入院中の子供がデザインしたぬいぐるみアバターを万博へ送り出し、アバターロボットを用いて現地で来場者と交流を行ったのちに、再び子どもたちのもとへ届けるプロジェクトが実践された。このプロジェクトはぬいぐるみに旅をさせ、その過程を伝えることで、ぬいぐるみが物語を持ったものとして子どもたちのもとに帰還することを目指したものである。今後の展開として、ロボットの主観的経験を生成AIによって日記化しSNSを用いて発信する「伊勢参り犬ロボット」の構想が紹介された。これは、ロボットが物理的な身体を持って偶然的な出会いを積み重ね、出会った人々と物語を共有することで、人々がその大きな物語の一部に参加している感覚を提供するものである。

この研究は、ロボットを単なる利便的ツールではなく、個人では安定して維持していくことの困難な人生の物語を外部化・共有化し、人々を緩やかに繋ぐ物語の媒介者としてデザインすることを目指している。

鈴木麗璽先生:複雑さの源としての生成AI

──概要

生成AIは、エージェント社会に「複雑さ」を付与する。AIエージェントのみが活動するSNS「Moltbook」の事例では、エージェントの間で独自の宗教や聖典が短期間で形成されるなど、AIによる擬似的な文化的活動の出現が報告された。この事例では人間エージェントによる介入があった可能性も指摘されているものの、このSNSの規模と内部の多様性は、従来の単純なルールベースのモデルでは到達困難であった、高度な社会的複雑性を生成AIが代替し得る可能性を示唆している。

このようにモデルを複雑化し、高度な文脈を生み出すという生成AIの役割を踏まえ、AIエージェントを用いて人間の「協力」のメカニズムを解明する実験が示された。大規模言語モデル(LLM)を搭載したエージェントによる社会的ジレンマ(囚人のジレンマ等)の検証では、記憶の長さやモデルの特性によって、協力が促進される場合と、逆に過去の裏切りへの恨みが許し(協力行動)を妨げ、裏切りを連鎖させる場合があることが判明した。記憶が信頼と報復のどちらを強化するかは、エージェントの性格に依存することが示唆された。

AI集団を理解する上で、相互作用の繰り返しと変化の積み重ねが重要な鍵となる。LLMはニュートラルな計算装置ではなく、すでに様々な特性の偏りを埋め込まれたものであり、それらの特性がAI集団の形成に影響を与えていた。さらに、世代を経るごとにエージェントの性格そのものが変化していくことも明らかになった。こうした観点から、高次の心理・社会的能力や、多様で協力的な集団の創発における「複雑性のエンジン」としてのLLMの役割が期待されている。

🔴総合討論

綾塚先生: ロボットの責任とはどのように定義できるのでしょうか。宮澤先生: そもそもなぜ人間の世界に「責任」があるのかを考える必要がありますね。ロボットに責任能力を持たせるためには、この概念の系譜を明らかにすることが必要なのではないでしょうか。物理的な安全性(力の強さや動きの安定性など)については基準を設けることが可能ですが、この場合にもやはりロボットよりむしろ製作者の責任ということが問題になるでしょう。高橋先生: 責任は共同の合意で成立するものであり。それぞれの環境内でルールの整備が必要です。文化差もありますよね。Mario先生: そもそも、ルールと責任の概念的な違いを明確にする必要があります。ルールは既存の社会の中で固められていくもので、そこではルール化されずに削り落とされるものが常にあります。だからこそ、ルールは世界の変化に合わせて更新し続けることが必要です。そしてそこを議論し続けることが倫理哲学の任務です。

岩崎陽一先生: 道徳的行動を学習させるためには、やはり痛みの経験(ペナルティ)が重要となるのでしょうか? イーロン・マスク氏はドルに代わわってエネルギーが通貨となる可能性を示唆していますが、こうした観点から、エネルギーの剥奪としてAIに痛みを与えることが可能だと言えるでしょうか? 宮澤先生: 身体の破壊として「痛み」を経験させることは可能です。身体がない場合にはご指摘のようにエネルギーが鍵になるでしょう。しかし、ビジネス的に自己を保存することを格率とすることは可能ですが、それは一般的な(人間の)痛みの経験とは別物でしょう。鈴木先生: 記憶が保持されることによってネガティブなものが蓄積してエージェントの特性が変化するという点に着目すれば、痛みとは別の矯正の可能性も考えられます。

高橋先生: 生成AIが語る内観・経験というものはどの程度信用できるのでしょうか?Mario先生: ロボットには痛みがあると考えるのは単なる幻想にすぎません。ロボットを見ている人間の感情として「かわいそう」というのはありますね。しかしこれは道徳的な問題とは切り離して考えるべきことです。ロボットを道徳的な主体として考えることの根拠にはなりません。高橋先生: 人間の感情という観点から言えば、「モノ供養」の文化があるように、モノに対する愛着は人間の心の安定のために重要ですよね。和泉悠先生: ものや動物に対して適切な行動をとる人の方が隣人としてふさわしいという観点から、ものに対する道徳的振る舞いを擁護する立場もあります。実際にそれらが痛みを持つかどうかとは別に。Mario先生: もちろん、動物に虐待をするのは道徳的に良いと言えません。しかしそのことが、ロボットの扱いにそのまま適用されるわけではありません。生理学と電子工学の区別が重要です。かわいいロボットを破壊することが問題なのは、ロボットの側の性質(痛みの経験可能性)というよりも、その行為の実行者(人間)の道徳性によるものです。

鈴木先生: 最近では、「チャッピー(Chat-GPTの愛称)が友達」という価値観が普及していますね。このように、生成AIを素朴に「パートナー」として捉えている人が多くいる中で、本日議論されているような問題をどのように捉えられるでしょうか?Mario先生: 生成AIの内部の仕組みを説明する人と、人間と人間の関係を説明する心理学者との協力関係が重要になるでしょう。そして、生成AIの使用に関する教育が必要です。高橋先生: ロボットをパートナーとみなす見方はゼロにすべきでしょうか? それはあっても良いでしょうか?Mario先生: 「チャッピー」をパートナーとみなす人が多数派であるのは問題です。昨年、オープンAI社がドライなChat-GPTを作ったら、苦情が殺到したという事件がありましたね。しかし、人々がどれだけチャッピーをパートナーとみなすようになっても、この「パートナー」の背後には人間はいません。この孤独な関係を多数の人が選ぶのは問題です。またこのパートナーを作っている会社があるということを意識するべきです。この会社は、いつでも彼らからパートナーを取り上げることもできるわけですから。高橋先生: ロボットを通じて社会性を学ぶことができるという考え方についてはどう思いますか? 私は、最終的に人間と人間の関係に還元されるような、ロボットとの関わり方が理想だと思っています。Mario先生: その試みは重要です。しかし、テクノロジーを介入させることは、常に格差の問題に関わるという点には注意が必要です。

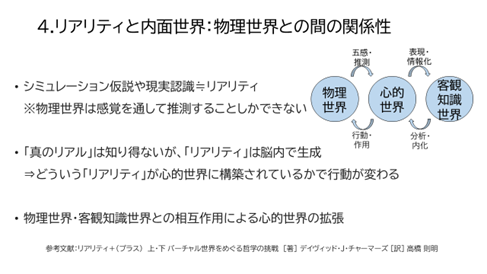

宮澤先生: 道徳性を持てるものと持てないものの違いはなんでしょうか? Mario先生: 言語を持った生物に道徳性が付与されます。痛み(非物理的なものも含めた)が懲罰として効果をもつことも重要です。宮澤先生: センサーで痛みを模倣することは道徳性の問題に影響するでしょうか?Mario先生: どれだけ優れたシミュレーションを行なっても、内的な経験(主観的な経験としての痛み)は保証されません。鈴木先生: ゲームの中で自律的なエージェントには、我々にはない「痛み」のあり方も可能でしょうか?高橋先生: それと関連して、意識は人工的に作れると考えますか? 何らかの生物学的な基盤が必須だと思いますか?Mario先生: 意識の研究はまだまだ途上にあります。最終的には人間の身体も物質に還元できますが、人間には主観的に見て意識や自由はあると我々は考えているわけですよね。では、自分と全く違うものにどのように意識や自由を与えることができるのでしょうか? 例え生成AIが意識や自由を示唆するような出力を行ったとして、それがデータのバイアスによるものではないということを証明することは困難でしょう。結局のところ、AIのデータ処理と人間の意識生成とは複雑性が違いすぎるのです。単純に比較したり重ね合わせたりすることはできません。

和泉先生: 身体性の問題についてお伺いします。バーチャルなアバターが悪意あるポストによって失敗した事例と、比較的成功した伊勢参り犬ロボットの場合とで、身体をもつことによる違いがあるのでしょうか? 人間の振る舞いがネット空間と対面で異なることとも類似しているのでしょうか?宮澤先生: ロボットは(AIと違って)物理的な仕事ができるし、労働の担い手としての有用性はあります。しかし労働力として、道具から人の側へ足を踏み入れることがどこまで許容されるのかという問題もあります。サービス業ロボットはそのグラデーションにあるのかもしれません。ロボットいじめを防ぐには、人間的な身体の形状は効果を持つかもしれませんね。

高橋先生: 私は「かわいさ」のアフォーダンスに関心があります。ある空間で、かわいいロボットが中央にいるようなエコロジーを形成することで、人間同士の関係性を向上させたいと思っています。ロボット自体はあくまでも人間同士の良い関係性を生み出すための道具として考えています。Mario先生: ロボットをかわいく作ることで、ロボットが人間よりもかわいくなってしまうという問題がありませんか? 人間への関心がロボットによって奪われてしまうというリスクです。高橋先生: そうなることは望んでいません。しかし例えば、伊勢参り犬は一期一会で、継続的な関係性を築くものではありません。私は、犬ロボットが旅するということが、このロボットへの過度な愛着のリスクを軽減させうるのではないかと期待しています。

シンポジウム 参加者リスト (発表順)

文責:大阪大学人文学研究科博士後期課程 葉柳朝佳音